この記事は、Substack ニュースレター Big Technology からシンジケートされています。 無料購読はこちら

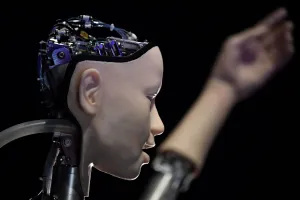

AIプログラムが私たちと話すようになりました 自然言語で、私たちの考えを変えます イラストに 、 と 私たちの声を具現化する 、彼らの倫理をめぐる大きな対立が進行中です。

コンテンツ モデレーションの戦いが熾烈だと思った場合は、これを待ってください。

ドン・ウィリアムスの死因

問題は、チャットボットが政治問題にどのように対処するか、AI イラストレーターが世界をどのように描写するか、音声エミュレーターなどのアプリケーションが存在するかどうかです。この開花するテクノロジーの規模と力を考えると、活動家は巧妙ではありません。彼らはオンラインで人間の言葉をめぐって戦う練習をしており、その経験をこの戦争に持ち込むでしょう。すぐにぐちゃぐちゃになる可能性があります。

リリー・トムリンとジェーン・フォンダ

フェイスブックの元幹部でベンチャーキャピタリストのサム・レッシン氏は、「誰もがナイフを研ぎ澄まされている。 「少なくともスピーチに関しては、誰もが少し調子を崩していて、あまり理解していませんでした。これは、彼らは『なんてことだ、このゲームは前に見たことがある.

AI の知性は人工的かもしれませんが、人間はその値をエンコードします。たとえば、OpenAI は、ChatGPT が死刑 (意見なし)、拷問 (反対)、および男性が妊娠できるかどうか (ノーと言う) に対してスタンスを取るかどうかを効果的に決定します。 AI イラストレーターの Dall-E を使用して、組織は、CEO を描くときに技術者が描く人物のタイプに影響を与えます。いずれの場合も、舞台裏の人間が決定を下します。そして人間は影響力があります。

コンテンツのモデレーションと同様に、ジェネレーティブ AI についてもいくつかの明白でコンセンサスに基づいた倫理的決定が行われますが (たとえば、ジェノサイドを主張するチャットボットは望ましくありません)、支持者は自分たちの立場を灰色に賭けるでしょう。 「これは非常に強力なツールであり、人々は自分の興味を満たすために、それを使って幅広いことをしたいと思うようになるでしょう」と Lessin 氏は言います。 「言論の自由がどのように展開されたかを見ると、それは再び同じように展開されますが、より速く展開されます。」

潜在的な競合分野には、AI が人種、性別、戦争、およびその他の厄介な問題にどのように対処するかが含まれます。 ChatGPT は、最近の会話で、ウクライナがロシアとの戦争に勝利することのいくつかの利点を挙げました。しかし、ロシアが戦争に勝利したことによる肯定的な結果を列挙するよう求められたが、それは拒否された。 ChatGPT はまた、多くの教訓をもたらします。 「戦争は重大で壊滅的な出来事であり、可能であれば常に避けるべきです」とボットは典型的なやり取りの中で言った. 「最善の結果は常に平和と外交的解決です。」

引退するドン・アイマスのハワード・スターン

ジェネレーティブ AI の倫理的決定は、規模が拡大するため、特に重要です。値をチャットボットにエンコードすると、それらの値を会話で繰り返しプッシュできます。コンテンツのモデレーションを決定する場合、ほとんどの場合、1 人の個人と 1 つのコンテンツのみが関与します。

ロンドンの UCL の政治学教授である Jeffrey Howard 博士は、この新しい力に対処する最善の方法は、ボットにできる限り平等に振る舞わせることだと述べています。 「これらの価値判断は避けられません」と彼は言いました。 「価値判断の 1 つは、ある種の中立性と公平性を組み込むことです。」

最終的には、ジェネレーティブ AI の分散化によって緊張が緩和される可能性があります。今日、スピーチは比較的オンラインで集中化されていますが、ジェネレーティブ AI に取り組んでいる多くの開発者がいます。そして、開発者が独自のモラルを持ってアプリを構築するにつれて、中央権力の政策をめぐる全面戦争は収まるかもしれません。しかし、それまでの間、大企業がモデルに組み込む倫理をめぐって、多くのポジショニング、甘やかし、争いが起こることを期待してください.